Zjistěte Svůj Počet Andělů

Etika umělé inteligence: Jak by marketéři měli přijímat inovace zodpovědně

Umělá inteligence (AI) není jen sci-fi fenomén přeměněný na realitu – je to technologická základna, vyvíjená po desetiletí přímo pod naším nosem. Umělá inteligence splnila sny o zvýšené efektivitě, přičemž mnoho značek již využívá AI marketing za posledních pár let.

Ačkoli to vyvolalo vzrušení a nadšení, existují obavy týkající se etiky umělé inteligence. Stejně jako mnoho inovací, vize technologického průmyslu metaverze měl děsivou podobnost s médii jako Black Mirror a Snow Crash . A s díly jako Podobenství o rozsévači, stroj a já, robot v rámci kulturního zeitgeistu je pochopitelné, proč fanoušci sci-fi, výzkumníci a technologové varují před nebezpečím ignorování etiky umělé inteligence.

V tomto článku definujeme, co je etika umělé inteligence, proč by se značky měly zajímat a jaké jsou hlavní etické problémy, kterým čelí marketéři, včetně jistoty zaměstnání, dezinformací a algoritmické zaujatosti. Podělíme se také o pět kroků, které vám pomohou udržovat etické postupy umělé inteligence v týmech a v celé organizaci.

Co je etika AI?

Etika umělé inteligence je systém morálních zásad a profesionálních postupů používaných k odpovědnému informování o vývoji a výsledcích technologie umělé inteligence. Odkazuje také na studii, jak optimalizovat dopad a snížit rizika a/nebo důsledky umělé inteligence.

Přední technologické společnosti, vládní subjekty jako Organizace spojených národů a výzkumné a datové vědecké komunity pracovaly na vytvoření a zveřejnění pokynů pro řešení etických problémů. Například Organizace spojených národů pro výchovu, vědu a kulturu (UNESCO) zveřejnila v listopadu 2021 první globální standard o etice umělé inteligence: Doporučení k etice umělé inteligence .

Na úrovni země i na místní úrovni existují určitá nařízení týkající se umělé inteligence, ale s růstem umělé inteligence a dalších nových technologií by podniky měly očekávat větší vládní regulaci. Jak se umělá inteligence dále integruje do našich životů, etika umělé inteligence se stává kritickou součástí digitální gramotnosti.

význam čísla 1212

Proč na etice umělé inteligence záleží

Společnosti již investují do AI, ale problémem je zajistit odpovědné používání.

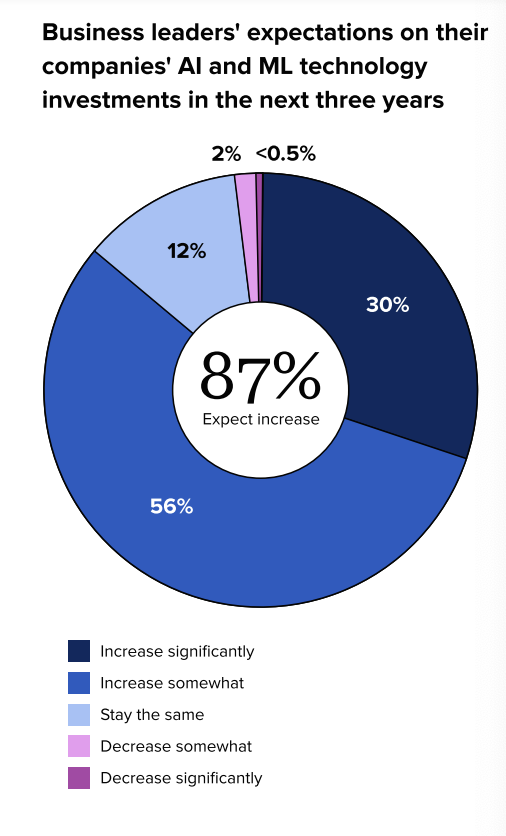

Podle Stav sociálních médií 2023: Umělá inteligence a data se dostávají do centra pozornosti obchodní lídři očekávají v příštích několika letech zvýšené investice do umělé inteligence. Naše zpráva také zjistila, že 98 % vedoucích firem souhlasí s tím, že společnosti potřebují lépe porozumět potenciálu AI a technologie strojového učení (ML) pro dlouhodobý úspěch.

Zatímco umělá inteligence může zlepšit výkon, zvýšit efektivitu a generovat pozitivní obchodní výsledky, značky také zažívají nepředvídatelné důsledky její aplikace. To může mimo jiné pramenit z nedostatku výzkumu nebo zkreslených datových souborů. Zneužívání umělé inteligence nebo zanedbávání etických problémů může mít za následek poškozenou pověst značky, selhání produktů, soudní spory a regulační problémy.

První krok k dodržování etických standardů napříč týmy ve vaší organizaci začíná pochopením problémů, kterým marketéři čelí, abyste mohli vytvořit plán na zmírnění těchto obchodních rizik a ochranu vaší značky.

Jaké problémy s etikou AI jsou pro obchodníky nejdůležitější

V technologickém průmyslu existuje celá řada etických problémů s umělou inteligencí, včetně, ale nejen, následujících:

- Generování falešného obsahu

- Vysvětlitelnost

- Společenský dopad

- Zneužívání technologie

- Zaujatost

- Odpovědnost za data a soukromí

- Spravedlnost

- Robustnost

- Průhlednost

- Udržitelnost životního prostředí

- Rozmanitost a inkluze

- Morální jednání a sladění hodnot

- Důvěra a zodpovědnost

Někteří věří, že umělá inteligence může pomoci vybudovat inkluzivnější technologie, systémy a služby, které mohou uspokojit různorodé populace. Klíčem je vytvořit etické rámce, předpisy a mechanismy, které zajistí odpovědné používání.

Členem arboreta , komunitní fórum společnosti Sprout, poznamenalo, že umělá inteligence má potenciál podporovat inkluzivitu a omezit předsudky/diskriminaci tím, že zajistí spravedlivé a nezaujaté rozhodovací procesy. Řešením problémů, jako je algoritmické zkreslení ve vývoji AI, by mohlo být možné utvářet budoucnost, kde bude AI pozitivní silou změny.

Spolu s potenciálem pozitivní změny existují také příležitosti ke zneužití nebo neetickému použití AI, jak se stává silnější. Naše komunita diskutovala o několika rizicích včetně porušení soukromí, manipulace s veřejným míněním a autonomních zbraní.

andělská čísla 1011

Komentáře, jako jsou tyto, jen poškrábou povrch etických obav napříč průmyslovými odvětvími, ale mezi hlavní problémy pro marketéry patří: bezpečnost práce, soukromí, předpojatost a diskriminace, dezinformace a dezinformace a otázky duševního vlastnictví/autorských práv, kterým se budeme podrobně věnovat v další sekce.

Dopad na pracovní místa a ztrátu pracovních míst

Roboti zajišťující světovou nadvládu jsou tou nejmenší starostí – alespoň prozatím.

A to proto, že výzkumníci a odborníci nejsou ohroženi jedinečnost technologie nebo myšlenka, že umělá inteligence překoná lidskou inteligenci a replikuje vlastnosti, jako jsou sociální dovednosti. Jsou si vědomi omezení AI a potenciálních důsledků náhrady zaměstnání.

Cílem výzkumu a investice do AI není nahradit lidi – má nám pomoci ušetřit čas a námahu, abychom mohli dělat efektivnější věci. Ředitel pro sociální média a partnerství společnosti Flock Freight, Bob Wolfley sdílel skvělou analogii pro AI : „AI je jako myčka nebo pračka v našich domovech. Myslete na všechen čas, který ušetříte tím, že nebudete mýt nádobí nebo oblečení ručně.“

V našem seriálu Nepřečteno členové marketingového a kreativního týmu společnosti Sprout diskutovali o tom, jak v současnosti používají AI, od vyžívání se v personalizovaných nákupech až po používání funkcí, jako je ViralPost®, které pomáhají plánovat příspěvky na sociálních sítích. Podívejte se na video níže, abyste slyšeli jejich žhavé pohledy na výhody a obavy z AI, včetně náhrady práce:

Obavy o soukromí

Obavy týkající se soukromí, ochrany a zabezpečení dat jsou pro značky na prvním místě. Investice do bezpečnosti jsou pro podniky stále důležitější prioritou, protože se snaží vyhnout jakýmkoli příležitostem pro sledování, hackování a kybernetické útoky. Jak se personalizace stává populárnější, značky zavádějí osvědčené postupy pro shromažďování, ukládání a analýzu dat, aby chránily zákazníky a organizace.

Algoritmické zkreslení a diskriminace

Vzhledem k tomu, že se učí z dat, může špatně konstruovaná nebo vycvičená AI prokázat zaujatost vůči nedostatečně zastoupeným podmnožinám dat. Vyskytlo se několik velkých případů zkreslení u uměleckých děl generovaných umělou inteligencí, chatbotů, softwaru pro rozpoznávání obličejů, algoritmů a nástrojů umělé inteligence pro náborové praktiky .

Například několik uživatelů TikTok a Twitter [přejmenováno na X v červenci 2023] vyvolalo vlákno s „#SouthSudan Barbie“ zdobené zbraněmi, což je negativní stereotyp spojený s regionem, který se potýká se sociálně-politickými problémy, jako je genocida a uprchlické krize. .

442 andělské číslo

Vzhledem k tomu, že zaujatost vstupuje do ještě nižších sázek, umělá inteligence používá případy, jako je tento, vyvstává otázka, jak můžeme bojovat proti zaujatosti a diskriminaci, když se trénovací datové sady mohou propůjčit k zaujatosti?

Dezinformace a dezinformace

Stejně jako lidé není AI dokonalá. Reakce umělé inteligence na výzvy mohou být nepřesné a existují obavy, že lidé budou šířit dezinformace se zlými úmysly. Spolu s hrozbami dezinformací existuje potenciál pro krizi značky a poškození reputace, zejména bez vhodných ochranných opatření a protokolů.

Problémy duševního vlastnictví a autorských práv

Pravděpodobně jste viděli obsazení Harryho Pottera jako postavy ve filmu Wese Andersona nebo občany Bikini Bottom zpívat ztvárnění populárních písní. Toto jsou příklady toho, kolik lidí používá umělou inteligenci k využití obrazu a podoby lidí nebo duševního vlastnictví.

Umělá inteligence je vynikajícím sparingovým partnerem pro kreativní úkoly, jako je brainstorming a vytváření obrysů, ale v závislosti na tom, jak jsou výstupy použity, může vést k porušování autorských práv, plagiátorství a porušování duševního vlastnictví. Například skupina umělců podal žalobu proti Midjourney a Stability AI v lednu 2023 s tvrzením, že tyto nástroje porušují práva milionů umělců. Generativní umělá inteligence otevírá legální plechovku červů a je zde stále mnoho prostoru, který je třeba pokrýt, ale vytvoření proaktivních pravidel a rámců pomůže zmírnit etická rizika.

význam 99

5 kroků k udržení etiky AI v týmech

Zde je pět kroků, které vám pomohou vést váš plán na zmírnění etických rizik AI:

1. Stanovte vnitřní základní pravidla a odpovědnosti za používání AI

Zvažte vytvoření etického týmu AI složeného z etiků, právních expertů, technologů a vůdců, kteří vám pomohou vytvořit základní pravidla pro vaši organizaci. Například používat generativní umělou inteligenci pouze pro koncepty a brainstorming, ale ne pro externě publikovaný obsah, je vynikající základní pravidlo.

Spolu s těmito základními pravidly definujte roli a odpovědnosti každého člena týmu zapojeného do AI, včetně etického týmu. Nastavte si své cíle a hodnoty také pro AI. To vám pomůže vytvořit základ pro vaše etické zásady a osvědčené postupy AI.

2. Definujte a kontrolujte roli AI

Umělá inteligence nemůže nahradit tvůrce obsahu, stratégy sociálních médií ani žádnou roli v marketingu. Identifikujte úkoly AI, které vyžadují lidský dohled nebo zásah, a určete cíle své etické zásady AI, abyste pomohli vytvořit procesy pro vývoj, správu a komunikaci o AI.

Jakmile určíte cíle svých etických zásad, identifikujte mezery a příležitosti pro AI ve vaší organizaci. Zvažte následující otázky:

- Jak organizace v současnosti využívá AI a jak ji chceme využívat v budoucnu?

- Jaký software a analýzy nám mohou pomoci zmírnit obchodní rizika?

- Jaké mezery vytváří technologie a analýzy? Jak je naplníme?

- Jaké testy nebo experimenty musíme provést?

- Jaká stávající řešení můžeme použít se současnými osvědčenými postupy pro naše produktové týmy?

- Jak využijete data a statistiky?

- Jak vytvoříme pozici naší značky a zasílání zpráv pro technologie AI a etiku?

3. Vytvořte vzduchotěsný proces hodnocení dodavatele

Spolupracujte se svými IT a právními týmy, abyste řádně prověřili všechny nástroje s možnostmi umělé inteligence a zavedli proces etického rizika. Jejich odborné znalosti vám pomohou vyhodnotit nové úvahy, jako je datová sada, na které je nástroj školen, a ovládací prvky, které dodavatelé používají ke zmírnění zkreslení AI. Proces due diligence pro každý nástroj před externím nebo interním spuštěním vám pomůže zmírnit budoucí rizika.

4. Udržujte transparentnost při zveřejňování

Spolupracujte se svými právními týmy a/nebo týmy pro ochranu osobních údajů na vývoji externích zpráv a/nebo prohlášení o vyloučení odpovědnosti, abyste uvedli, kde a kdy vaše značka spoléhá na AI. Tyto zprávy lze použít pro obsah, zákaznickou péči atd. Například TikTok aktualizoval své pokyny komunity požadovat, aby tvůrci označovali obsah generovaný umělou inteligencí. Komunikace vašich etických standardů a rámců pro prosazování etiky AI pomůže získat důvěru kolegů, potenciálních zákazníků a zákazníků.

5. Pokračujte ve vzdělávání napříč vedením a týmy

AI není něco obchodní vedení může spěchat do. Jako každá nová vlna vznikajících inovací bude kromě nových technologických milníků existovat křivka učení. Pomozte vyrovnat podmínky tím, že budete pořádat interní školení a workshopy, abyste vzdělávali všechny členy týmu, vedoucí a zúčastněné strany o etice umělé inteligence a o tom, jak ji zodpovědně budovat.

Udělejte správnou věc s etikou AI

Zvažování etiky není jen správná věc – je to kritická součást využití technologie AI v podnikání.

Zjistěte další pohledy od lídrů a marketérů na to, jak umělá inteligence ovlivní budoucnost sociálních sítí u nás webinář, spolu s dalšími zjištěními z The State of Social Media Report 2023 a tipy pro vytváření působivého sociálního obsahu.

Sdílej Se Svými Přáteli:

1033 andělské číslo lásky

![Uživatelská odpověď na fotografii „#SouthSudan Barbie“ vygenerovanou umělou inteligencí ve vláknu Twitteru [od července 2023 přejmenováno na X]. Příspěvek zní: „Stále vám říkáme'all that bias is built into this AI-generated garbage."](https://clarksbarandrestaurant.com/img/all-marketing-insights/C2/ai-ethics-how-marketers-should-embrace-innovation-responsibly-3.png)